مایکروسافت یک سیستم هوش مصنوعی (AI) تولید کننده گفتار جدید به نام VALL-E 2 توسعه داده است که به گفته آنها دقیقتر از آن است که در دسترس عموم قرار گیرد.

مایکروسافت این هفته اعلام کرد که توسعه VALL-E 2، دومین نسخه از تولید کننده گفتار VALL-E AI را به پایان رسانده است. به گفته محققان، VALL-E 2 آنقدر پیشرفته است که انتشار آن برای عموم خطرناک است. زیرا می توان از این ابزار برای تقلید قانع کننده صدای واقعی انسان استفاده کرد. بنابراین، این فرم فقط برای اهداف تحقیقاتی در نظر گرفته شده است.

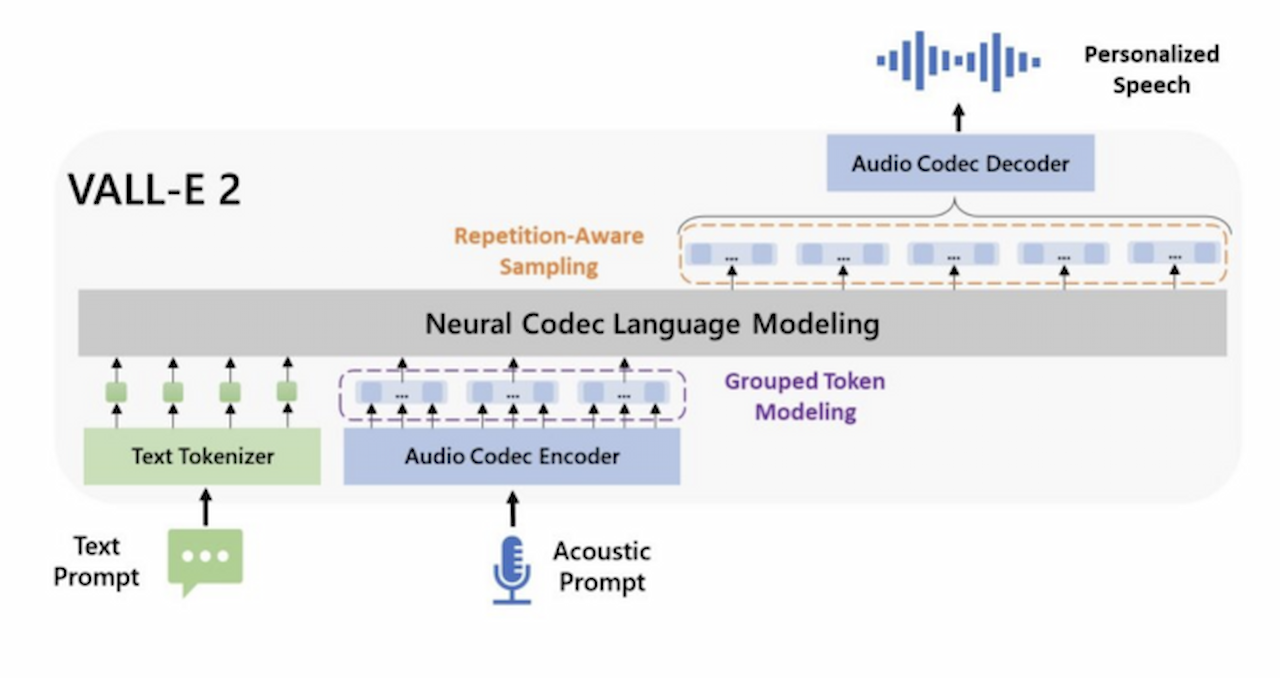

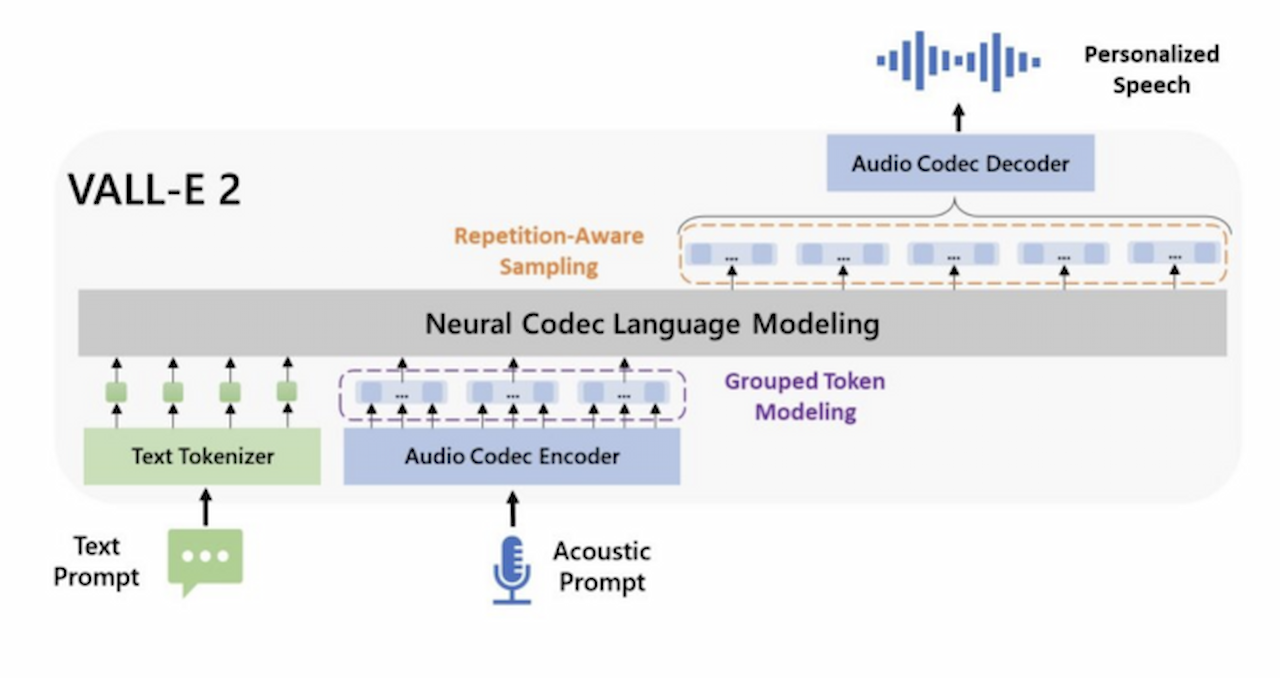

Extremetech می نویسد که VALL-E 2، مانند نسخه قبلی، یک مدل زبان کدگذاری عصبی است. کلاسی از یادگیری عمیق که از تکنیک های شبکه عصبی برای رمزگذاری و رمزگشایی اطلاعات زبانی استفاده می کند. با این حال، بر خلاف VALL-E، مدل VALL-E 2 متن به گفتار (TTS) را نصب می کند، که از ورودی متن برای تولید گفتار برای صداهایی استفاده می کند که به طور خاص برای آنها آموزش ندیده است.

این مدل از کتابخانه های آموزشی گسترده LibriSpeech و VCTK برای نگاشت ورودی های متن به خروجی های صوتی مرتبط استفاده می کند. این نقشه برداری تغییرات در تلفظ، لحن، موسیقی و غیره را در نظر می گیرد. پس از شنیدن یک کلیپ کوتاه از فردی که با ورودی متن کاربر صحبت می کند، VALL-E 2 برخی از این تغییرات را در پاسخ خود اعمال می کند تا گفتار مصنوعی تولید کند که نمونه های صوتی را شبیه سازی می کند و کلمات ورودی متن را شامل می شود.

هر کسی که در گذشته جملات خشک و مصنوعی تولید کننده های گفتار هوش مصنوعی را شنیده باشد، می داند که این کار چقدر دشوار است. اما به گفته محققان گروه محاسبات زبان طبیعی در Microsoft Research Asia، VALL-E 2 این کار را یکپارچه انجام می دهد. در واقع، به گفته محققان، این تولید کننده گفتار اولین نمونه ای است که به سطح “شبیه انسان” رسیده است و در دسترس قرار دادن آن برای عموم می تواند مضرتر باشد.

محققان در بیانیه ای نوشتند:

VALL-E 2 فقط یک پروژه تحقیقاتی است. در حال حاضر، ما هیچ برنامه ای برای ادغام VALL-E 2 در محصول یا گسترش دسترسی عمومی نداریم. این مدل ممکن است خطرات بالقوه سوء استفاده داشته باشد. مانند جعل صدا یا تقلید از یک گوینده خاص.

این تیم خاطرنشان میکند که VALL-E 2 در زمینههای آموزشی یا سرگرمی مؤثرتر خواهد بود. زیرا در این شکل می تواند با حفظ صدای طبیعی خاص انسان، دوره های آنلاین یا کتاب های صوتی را روایت کند.

با این حال، حتی این می تواند مشکلات اخلاقی ایجاد کند. تولیدکنندههای گفتار دیگر، مانند Voicebox Meta و ابزار روایت هوش مصنوعی آمازون، به دلیل اجازه دادن به هوش مصنوعی برای تقلید صدای یک شخص واقعی، به خصوص زمانی که آن شخص برای رضایت در دسترس نباشد، بحثهایی را به راه انداختهاند.

مانند سایر اشکال هوش مصنوعی مولد، مولدهای گفتار سوالاتی را در مورد جایگزینی عملکردهای انسانی مطرح کرده اند. مشکلی که به ویژه صداپیشگان را نگران می کند. با خاموش کردن VALL-E 2، مایکروسافت می تواند به راحتی محدودیت های عملی مدل را آزمایش کند. محققان می نویسند:

ما آزمایشها را با این فرض انجام دادیم که کاربر موافق است گوینده هدف در تولید گفتار باشد. اگر قرار است این مدل برای گنجاندن سخنرانان ناشناخته در دنیای واقعی گسترش یابد، باید پروتکلی برای اطمینان از تأیید با استفاده از صدای گوینده و مدل تشخیص گفتار داخلی ایجاد شود.

parseek به نقل از یستا

مطالب مرتبط

افغانستان و ایران تفاهمنامه اتصال شبکههای اینترنت امضا کردند

آیا مدارس اصفهان فردا چهارشنبه (۵ دی ۱۴۰۳) تعطیل است؟

خروج نیروهای فرانسوی از جمهوری چاد (یکم دی ۱۴۰۳)